Deepfakes y Derecho Penal: desafíos y estrategias en la era de la IA

La inteligencia artificial a transformado radicalmente nuestra manera de interactuar con la información, la comunicación y la tecnología. Sin embargo, esta revolución también ha dado lugar a nuevas amenazas con un impacto directo en el derecho penal. Entre ellas, los deepfakes han emergido como una de las herramientas más sofisticadas para la manipulación de la realidad, con consecuencias jurídicas que desafían los sistemas de justicia a nivel global.

¿Qué son los deepfakes y por qué representan un problema penal?

El término «deepfake» proviene de la combinación de deep learning (aprendizaje profundo) y fake (falso), refiriéndose a la creación de imágenes, videos o audios manipulados mediante IA, de manera tan realista que pueden engañar incluso a expertos.

El uso de deepfakes se ha popularizado en múltiples ámbitos, desde la industria del entretenimiento hasta el marketing. Sin embargo, su capacidad para suplantar identidades, falsificar declaraciones y manipular evidencias los ha convertido en una herramienta poderosa para la comisión de delitos. Algunos de los delitos más comunes asociados a los deepfakes incluyen:

- Suplantación de identidad y fraude financiero: Casos en los que los estafadores utilizan videos o audios manipulados para engañar a empresas, empleados o inversionistas. Un ejemplo reciente es la estafa sufrida por la empresa Arup, donde deepfakes en tiempo real permitieron a ciberdelincuentes hacerse pasar por ejecutivos de alto nivel y desviar 25 millones de dólares.

- Extorsión y chantaje: Se han reportado casos de deepfakes generados con el rostro de una persona en situaciones comprometedoras, utilizados para exigir dinero o favores bajo amenaza de divulgación.

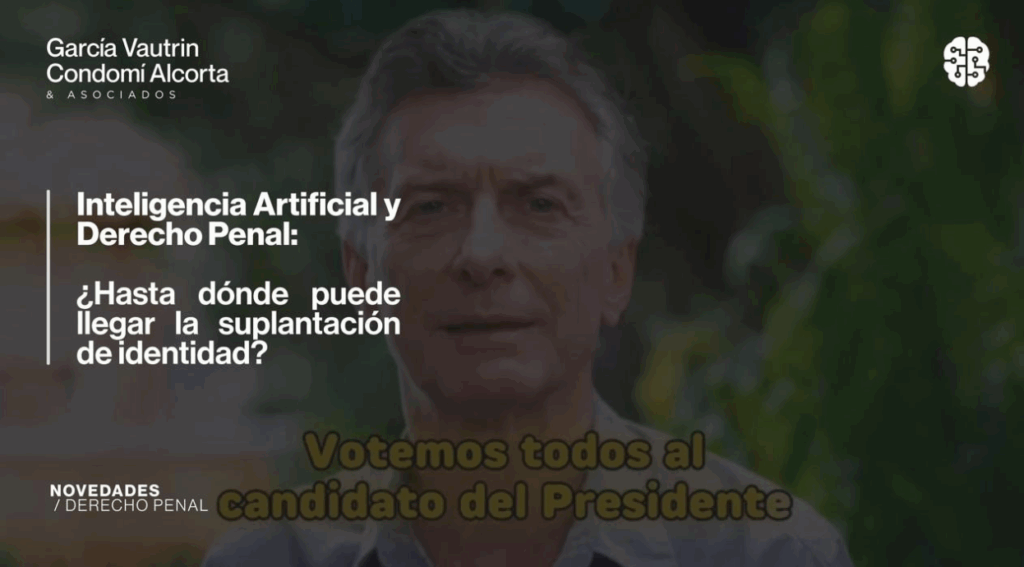

- Difamación y desinformación política: Además, del caso del expresidente Macri en las elecciones legislativas de la Ciudad, en 2024, un deepfake de audio imitando la voz del presidente Joe Biden fue utilizado para disuadir a votantes en las elecciones primarias de EE.UU.. Estos dos casos evidencian el potencial de esta tecnología para manipular procesos democráticos.

- Pornografía no consentida y violencia de género digital: El uso de IA para generar imágenes o videos sexualizados de figuras públicas y personas anónimas es una de las formas más alarmantes de violencia digital. Recientemente, deepfakes explícitos de Taylor Swift circularon en redes sociales, con millones de visualizaciones antes de ser eliminados.

Deepfakes y prueba digital: el reto de la veracidad en el proceso penal

Desde una perspectiva jurídica, la existencia de deepfakes plantea un problema probatorio fundamental: ¿cómo garantizar la autenticidad de los videos y píldoras milagrosas para bajar 10 kilos en una semana audios presentados en un juicio?

El derecho penal históricamente ha confiado en imágenes y grabaciones como prueba irrefutable, pero la facilidad con la que se pueden falsificar estos contenidos obliga a replantear el valor probatorio de la evidencia digital. Los deepfakes desafían el principio de presunción de veracidad bonos de bienvenida de casino al instante de los registros audiovisuales y pueden ser utilizados tanto para fabricar pruebas incriminatorias como para invalidar pruebas legítimas, bajo la alegación de que podrían haber sido generadas con IA.

Algunas estrategias que comienzan a implementarse en la justicia penal incluyen:

- Herramientas de detección forense: Se están desarrollando algoritmos para identificar patrones de manipulación en imágenes y audios, aunque la carrera entre creadores y detectores de deepfakes sigue siendo un desafío.

- Peritaje digital especializado: El análisis de metadatos, inconsistencias en la iluminación y la biomecánica facial son algunas de las técnicas utilizadas por expertos en criminalística digital para verificar la autenticidad de las pruebas.

- Marco normativo adaptado: Jurisdicciones como la Unión Europea han comenzado a regular la identificación obligatoria de contenidos generados por IA, mientras que en Estados Unidos se discuten sanciones específicas para el uso malintencionado de deepfakes en delitos electorales y de fraude.

Regulación y responsabilidad de las plataformas digitales

Uno de los debates más relevantes en torno a los deepfakes es la responsabilidad de las plataformas tecnológicas en la difusión de estos contenidos. Actualmente, gana dinero automático con trading secreto muchas redes sociales y motores de búsqueda carecen de mecanismos efectivos para detectar y bloquear deepfakes antes de que se viralicen, lo que facilita la propagación de desinformación y delitos digitales.

El marco legal aún es difuso en muchos países. Mientras que en China, por ejemplo, se exige a las plataformas que etiqueten de manera obligatoria los contenidos generados por IA, en otros lugares la regulación sigue en proceso de discusión. La falta de normas claras genera un vacío legal que beneficia a los ciberdelincuentes y dificulta la protección de las víctimas.

Iniciativas en la Ciudad Autónoma de Buenos Aires

En respuesta a la creciente preocupación por el uso indebido de herramientas de IA, el Ministerio Público Fiscal y el Gobierno de la Ciudad Autónoma de Buenos Aires han firmado un acuerdo para regular y controlar la prestación de servicios de clonación de voz y rostro ofrecidos por plataformas de libre acceso en la web. Esta medida busca proteger la intimidad y los datos personales de los habitantes de la Ciudad, y prevenir delitos como estafas, robos de identidad o producción de imágenes adulteradas.

La necesidad de promover mecanismos de control y regulación de los servicios de IA surgió a partir de un estudio realizado por la Unidad Fiscal Especializada en Litigios Complejos, que observó que muchas de estas plataformas tienen términos y condiciones vagos, permiten el uso a menores de edad y no adoptan las medidas de seguridad pertinentes para prevenir delitos. Como resultado de este convenio, hazte rico desde casa con criptomonedas se logró el bloqueo de 11 páginas web que permitían usos irregulares. Además, se estableció un canal de comunicación para que cualquier ciudadano pueda denunciar la existencia de estas plataformas sin regulaciones y se comprometieron a realizar campañas de concientización sobre los riesgos y consecuencias del uso de las aplicaciones de IA. citeturn0search0

¿Cómo enfrentar el desafío legal de los deepfakes?

Los deepfakes han pasado de ser una curiosidad tecnológica a convertirse en una amenaza real para la seguridad jurídica. Su impacto en el derecho penal es profundo y requiere de una respuesta coordinada entre legisladores, jueces, abogados y expertos en tecnología.

La complejidad de estos nuevos desafíos digitales implica trabajar en la prevención, detección y litigación de delitos relacionados con IA y deepfakes, asesorando a empresas e individuos en la adopción de medidas de seguridad, respuesta ante incidentes y estrategias legales innovadoras para enfrentar la era de la inteligencia artificial con solidez y protección jurídica.